- Best-IA Newsletter

- Posts

- Boletín Semanal Best-IA #127

Boletín Semanal Best-IA #127

Esta semana, muchas noticias distintas apuntan en la misma dirección: la IA deja de ser un conjunto de modelos aislados y empieza a operar como infraestructura activa, compuesta por agentes, herramientas, memoria, protocolos y bucles de auto-optimización. Más que lanzamientos independientes, estamos viendo piezas de un mismo sistema encajar.

Tutoriales

OpenAI Codex App: ¿El Fin de los IDEs AI?

Diseña y Crea Web Apps con Stitch + Antigravity

Noticias

OpenAI

GPT-5.3-Codex: un modelo que programa… y se desarrolla a sí mismo

OpenAI ha presentado GPT-5.3-Codex, una nueva versión de su modelo orientado a programación y trabajo profesional que combina mejoras técnicas, mayor velocidad y un hito relevante: su uso activo en su propio proceso de desarrollo interno.

🔑 Puntos clave

Modelo unificado para código y conocimiento profesional: GPT-5.3-Codex mejora el rendimiento en tareas de programación avanzada sin perder capacidades en trabajo profesional, igualando a GPT-5.2 en evaluaciones de conocimiento.

Mejora clara en benchmarks técnicos: alcanza nuevo estado del arte en SWE-Bench Pro y Terminal-Bench, reforzando su posición como modelo de referencia en ingeniería de software.

Desarrollo autoasistido: es el primer modelo de OpenAI que fue utilizado para depurar entrenamiento, gestionar despliegues y analizar evaluaciones durante su propia creación.

Más rápido e interactivo: funciona un 25 % más rápido en Codex y actúa como colaborador activo, mostrando progreso, explicando decisiones y permitiendo ajustes en tiempo real.

Capacidades de ciberseguridad: es el primer modelo clasificado como de alta capacidad en tareas de ciberseguridad y entrenado explícitamente para identificar vulnerabilidades de software.

🎯 GPT-5.3-Codex refuerza la transición hacia modelos que no solo ejecutan tareas, sino que participan en ciclos de desarrollo cerrados, acelerando ingeniería, aumentando autonomía y anticipando sistemas capaces de optimizar su propia evolución técnica.

OpenAI Codex: una app nativa para coordinar agentes de IA

OpenAI ha anunciado la disponibilidad de la app Codex, una aplicación nativa para macOS que funciona como centro de control para crear, gestionar y coordinar múltiples agentes de IA desde una interfaz unificada.

🔑 Claves

Centro de comando para agentes: Codex permite organizar y supervisar varios agentes de IA trabajando en paralelo, manteniendo contexto y control sobre tareas complejas.

Acceso ampliado temporal: OpenAI habilita Codex también para planes gratuitos y Go, con límites de uso aumentados en otros planes.

🎯 Codex señala el paso de asistentes aislados a entornos de orquestación de agentes. Refuerza la tendencia hacia IA más operativa, capaz de gestionar flujos completos de desarrollo y automatización con menor fricción humana.

OpenAI Frontier: plataforma de “AI coworkers” para empresas

OpenAI ha lanzado OpenAI Frontier, una plataforma orientada a empresas para construir y gestionar agentes de IA persistentes integrados en flujos de trabajo reales.

🔑 Claves

AI coworkers: agentes diseñados para trabajar de forma continua, no como prompts puntuales.

Integración profunda: conexión con CRM, datos internos, sistemas de tickets y archivos corporativos.

🎯 Frontier consolida el giro de la IA hacia infraestructura laboral, donde los modelos pasan de asistentes reactivos a componentes estables del organigrama digital de las empresas.

GPT-5 reduce un 40 % el coste de la síntesis de proteínas en colaboración con Ginkgo

OpenAI ha publicado un caso de uso donde GPT-5 se integra en un laboratorio biológico automatizado junto a Ginkgo Bioworks, logrando reducir de forma significativa el coste de diseñar y producir proteínas funcionales.

🔑 Claves del avance

IA en bucle cerrado: GPT-5 propone experimentos, el laboratorio los ejecuta automáticamente y los resultados vuelven al modelo para refinar las siguientes iteraciones.

Optimización del diseño proteico: el sistema aprende qué secuencias funcionan mejor, descartando rápidamente vías ineficientes.

Reducción de costes del 40 %: menos experimentos fallidos y menor consumo de tiempo y materiales en el proceso.

Escalabilidad científica: el enfoque permite repetir el ciclo miles de veces, algo inviable con supervisión humana constante.

🎯 Este caso muestra a la IA como infraestructura científica: no solo acelera la investigación, sino que abarata su ejecución, acercando la biología computacional a un modelo industrial, continuo y altamente automatizado.

ChatGPT amplía soporte completo para MCP Apps

OpenAI ha anunciado compatibilidad total de ChatGPT con MCP Apps, reforzando la interoperabilidad entre aplicaciones externas y el ecosistema ChatGPT.

Claude Opus 4.6: salto en razonamiento, agentes y contexto largo

Anthropic ha presentado Claude Opus 4.6, una actualización de su modelo más avanzado que refuerza el razonamiento prolongado, el trabajo con agentes y la fiabilidad en entornos complejos, incluyendo contextos de hasta un millón de tokens en beta.

🔑 Claves del anuncio

Razonamiento y planificación mejorados: Opus 4.6 planifica antes de actuar, sostiene tareas agénticas durante más tiempo y detecta mejor sus propios errores.

Contexto de 1M tokens (beta)

Novedades en la API: Control más fino del esfuerzo de razonamiento, adaptive thinking y compresión de contexto para agentes de larga duración.

Fast mode experimental: Versión interna 2,5× más rápida, más costosa, orientada a proyectos urgentes y de alto riesgo.

🎯 Opus 4.6 refuerza la tendencia hacia modelos más autónomos y persistentes, capaces de operar como infraestructuras de trabajo intelectual continuo, un paso relevante en la evolución de agentes fiables para entornos profesionales complejos.

Perplexity

Deep Research Advanced

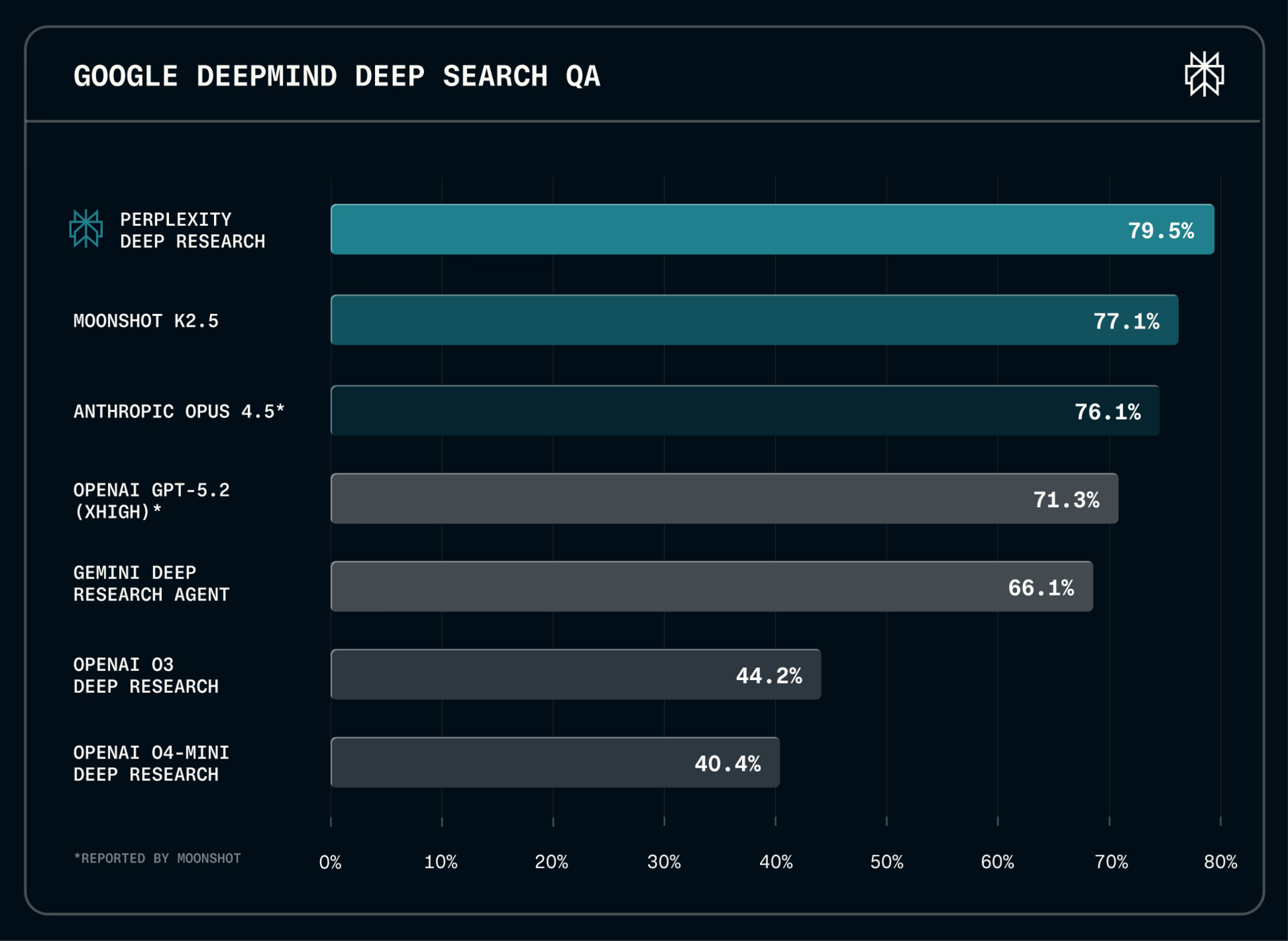

Perplexity ha anunciado una versión Advanced de Deep Research orientada a investigación profunda de uso real, con mejoras en precisión, fiabilidad y experiencia, y acompañada de un nuevo benchmark abierto para evaluar agentes de investigación.

🔑 Claves del anuncio

Deep Research Advanced: nueva versión con rendimiento líder en benchmarks internos y externos, enfocada a investigación compleja y toma de decisiones.

Modelo y arquitectura: todas las consultas Advanced se ejecutan con Perplexity AI usando Claude Opus 4.5 y el mismo agentic harness y toolkit para asegurar consistencia.

Disponibilidad: acceso inmediato para usuarios Max y despliegue gradual para Pro; los usuarios Max cuentan con mayores límites de uso.

🎯 Este movimiento apunta a estandarizar la evaluación de agentes de investigación con métricas prácticas, impulsando herramientas más fiables para contextos profesionales donde la calidad del análisis impacta directamente en decisiones económicas y técnicas.

Model Council: investigación con múltiples modelos en paralelo

Perplexity ha presentado Model Council, un nuevo modo para usuarios Max que permite abordar una consulta mediante varios modelos frontera trabajando de forma asíncrona, con un modelo coordinador encargado de sintetizar una respuesta final más sólida desde múltiples perspectivas.

La propuesta desplaza el foco desde el rendimiento de un único modelo hacia la orquestación colectiva: distintos LLMs razonan en paralelo, aportan enfoques complementarios y delegan la integración final en un modelo “Chair”, actualmente Claude Opus 4.5. Este rol coordinador no es fijo y podrá cambiar dinámicamente según cuál sea el modelo más competente en cada momento, reforzando el carácter agnóstico de la plataforma.

🎯 Model Council refuerza la idea de la IA como sistema colectivo: la calidad ya no emerge solo del mejor modelo individual, sino de la coordinación entre agentes especializados bajo una capa común de herramientas y síntesis.

Qwen3-Coder-Next: modelo abierto optimizado para agentes de programación

Alibaba ha presentado Qwen3-Coder-Next, un modelo de pesos abiertos diseñado específicamente para agentes de programación y desarrollo local, con un enfoque claro en eficiencia, entrenamiento agentico y compatibilidad con entornos reales de trabajo.

🔑 Claves del anuncio

Entrenamiento agentico a gran escala: más de 800.000 tareas verificables ejecutadas en entornos reales, orientadas a flujos completos de desarrollo.

Eficiencia computacional: arquitectura con 80B parámetros totales, pero solo 3B activos en inferencia, manteniendo un equilibrio notable entre coste y rendimiento.

Resultados en benchmarks: supera el 70 % en SWE-Bench Verified usando el scaffold SWE-Agent, compitiendo con modelos abiertos mucho más grandes.

🎯 Qwen3-Coder-Next refuerza la tendencia hacia modelos especializados y eficientes para agentes autónomos, donde el rendimiento práctico en tareas reales pesa más que el tamaño bruto del modelo en el avance de la IA aplicada al software.

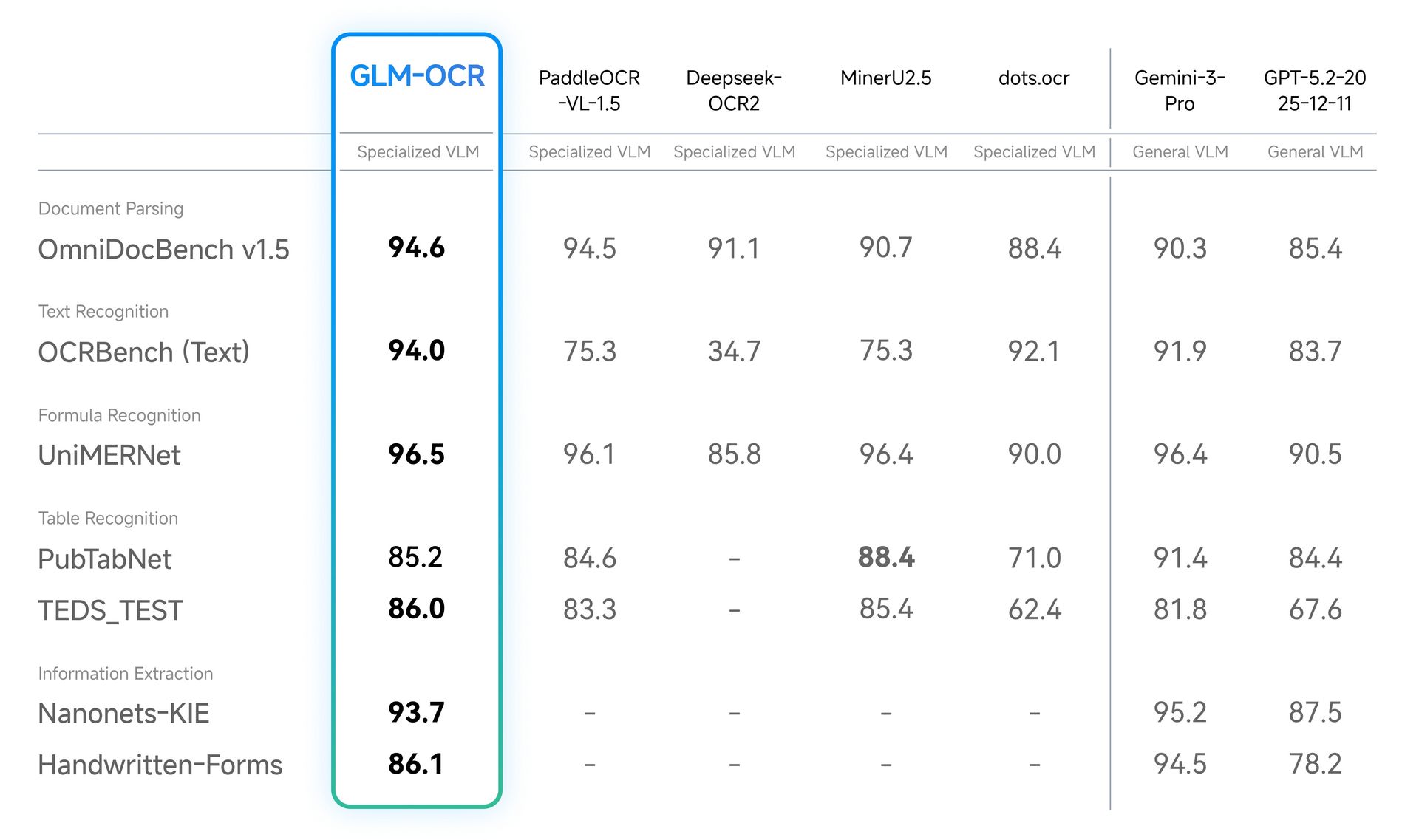

GLM-OCR: comprensión documental avanzada con pesos abiertos

Z.ai ha lanzado GLM-OCR, un modelo de Document Understanding que va más allá del OCR tradicional al combinar análisis de layout y contenido, orientado a documentos complejos con despliegue eficiente.

🎯 GLM-OCR muestra que modelos pequeños pueden resolver tareas documentales complejas, habilitando despliegues locales y sustituyendo OCRs enterprise y pipelines manuales en legal, finanzas y academia, alineado con la tendencia hacia IA eficiente y especializada.

Pruébalo en https://ocr.z.ai/

Modelos de vídeo

Grok Imagine 1.0: salto en generación de vídeo y audio con IA

xAI ha lanzado Grok Imagine 1.0, una actualización relevante de su modelo de generación de vídeo que mejora duración, resolución y calidad sonora, con un progreso claro en seguimiento de prompts y coherencia narrativa. Los clips alcanzan hasta 10 segundos en 720p, con movimiento más fluido y mayor nivel de detalle, mientras que el audio gana expresividad, sincronización y variedad emocional.

Más allá de las métricas, Imagine 1.0 destaca por su enfoque en usos creativos cotidianos: vídeo corto con voz, música y narrativa integrada, acercando la generación multimodal a contextos reales de comunicación, entretenimiento y marketing digital.

Kling 3.0: creación multimodal nativa con control cinematográfico

Kling AI ha presentado Kling 3.0, una nueva versión de su motor creativo orientada a producción audiovisual integral, combinando vídeo, imagen y audio de forma nativa. La mejora clave está en la consistencia: personajes, estilos y elementos visuales se mantienen estables a lo largo de escenas y tomas, con mayor control narrativo y soporte para secuencias multi-shot personalizables.

Con generación de vídeo de hasta 15 segundos, audio nativo mejorado y nuevas capacidades de imagen 4K, Kling 3.0 refuerza la tendencia hacia herramientas creativas todo-en-uno, pensadas para creadores individuales y pequeños estudios que buscan mayor control sin complejidad técnica excesiva.

🎯 El vídeo generativo deja atrás la fase de demo y entra en una etapa de producción creativa más controlable y multimodal, donde la coherencia narrativa y la integración de audio e imagen empiezan a ser tan importantes como la calidad visual.

Modelos de Audio

Eleven v3: la voz sintética entra en fase de producción

ElevenLabs ha anunciado la disponibilidad general de Eleven v3, una actualización centrada en mejorar expresividad, control creativo y estabilidad en textos largos. Las nuevas voces muestran mayor rango emocional, entonación más natural y ajustes más precisos de estilo y ritmo, lo que refuerza su uso en narración, diálogo y contenido profesional.

Más allá de la calidad, Eleven v3 consolida la generación de voz como una interfaz madura: fiable, controlable y preparada para integrarse en productos, agentes conversacionales y flujos multimedia sin fricción técnica.

Voxtral Transcribe 2: transcripción en tiempo real como infraestructura abierta

Mistral AI ha presentado Voxtral Transcribe 2, una nueva generación de modelos speech-to-text con baja latencia, diarización de hablantes y un coste muy reducido, pensados para agentes de voz y uso a gran escala. Destaca especialmente Voxtral Realtime, con arquitectura nativa en streaming y pesos abiertos bajo licencia Apache 2.0.

Con precios agresivos y rendimiento competitivo, Voxtral refuerza la transcripción fiable como capa básica para call centers, asistentes interactivos y sistemas conversacionales donde la voz ya no es una feature, sino infraestructura.

🎯 La voz deja de ser un complemento y se consolida como infraestructura bidireccional para agentes y aplicaciones interactivas: generación expresiva en la salida y transcripción barata y en tiempo real en la entrada.

Modelos de Imagen

Ideogram activa la edición de imágenes por texto

Ideogram ha lanzado la edición de imágenes basada únicamente en prompts: ya no hacen falta máscaras ni pinceles, basta con describir en texto los cambios deseados para modificar cualquier imagen directamente.

Robots

Atlas eléctrico ejecuta un backflip con aprendizaje corporal completo

El Atlas eléctrico de Boston Dynamics ha realizado un round-off backflip perfecto gracias a un marco de aprendizaje de cuerpo completo desarrollado por el RAI Institute, combinando atletismo avanzado y marcha natural; ambas entidades pertenecen a Hyundai Motor Group.