- Best-IA Newsletter

- Posts

- Boletín Semanal Best-IA #97

Boletín Semanal Best-IA #97

Aprende IA, día a día.

Tutoriales

Crea videos con Midjourney

Herramientas

DeepSite v2 en Hugging Face

Es un Space en Hugging Face que genera sitios web o mini apps (incluso juegos tipo Snake o visualizadores de datos) a través de prompts en lenguaje natural — nada de HTML/CSS manual.

Usa el modelo DeepSeek‑V3‑0324 y se integra con los Inference Providers de HF para generar código en tiempo real.

🚀 Características clave

Generación instantánea de páginas web, juegos y visualizaciones solo con descripciones.

Previsualización en tiempo real: escribes en la izquierda, ves el resultado en la derecha .

Open‑source: puedes clonar el repo, meter tu token HF y ejecutarlo localmente o en Docker

Un repositorio de oro para crear agentes GenAI de principio a fin

Un nuevo repositorio en GitHub está arrasando con más de 3.400 estrellas en solo 4 días. Ofrece tutoriales prácticos y con código para construir agentes de IA generativa de nivel profesional, desde la idea inicial hasta el despliegue real.

Incluye patrones probados y blueprints reutilizables para lanzar productos funcionales en el mundo real. Si estás construyendo con IA, este repo es una joya imprescindible.

Noticias

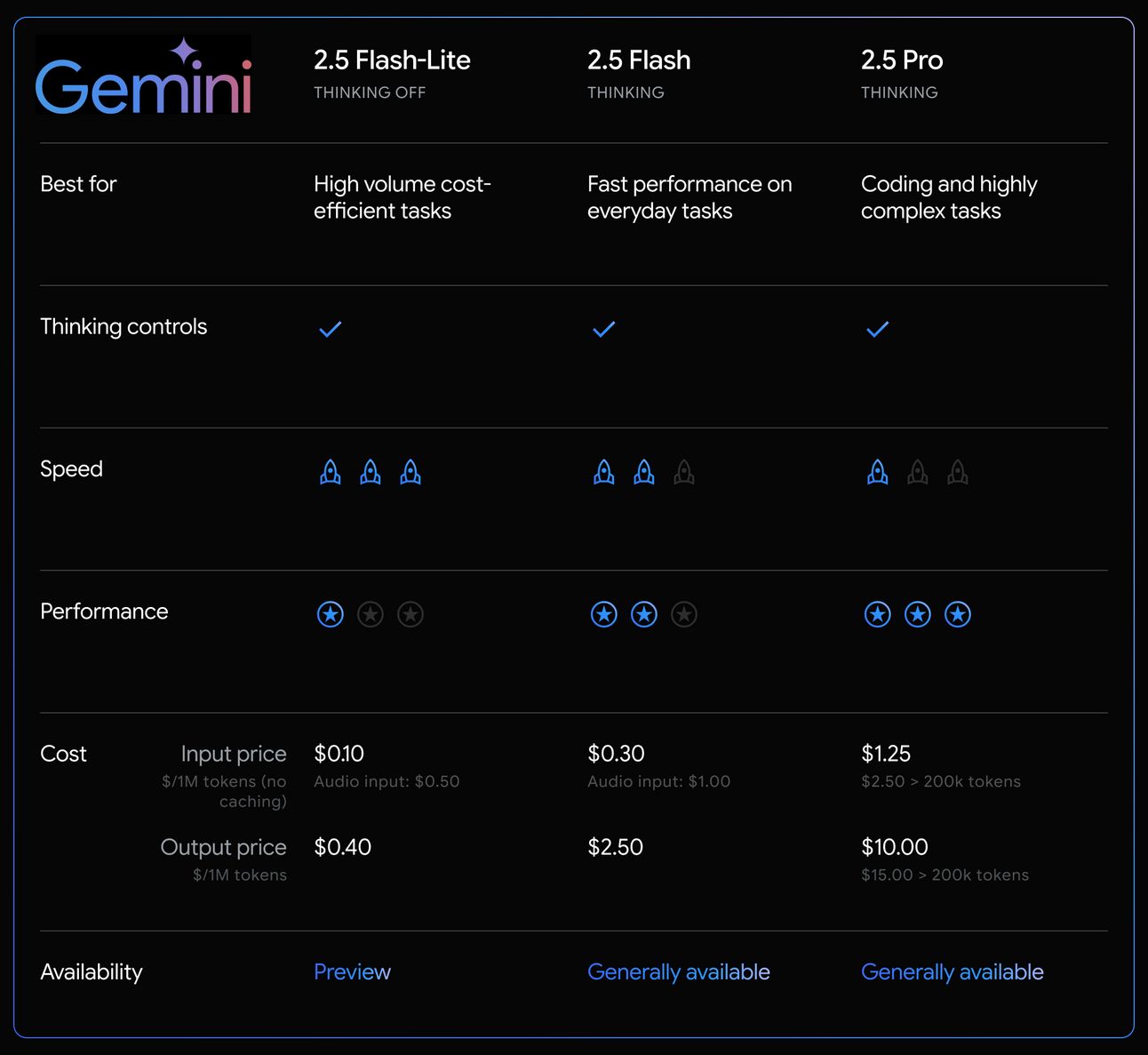

Google lanza Gemini 2.5 Flash-Lite y estabiliza sus modelos Flash y Pro

Google ha anunciado la disponibilidad general (GA) de sus modelos Gemini 2.5 Flash y Pro, junto con el lanzamiento en vista previa de Gemini 2.5 Flash-Lite, una versión ultraligera y rápida diseñada para eficiencia y bajo coste.

🔑 Puntos clave del anuncio

Modelos estables y nueva versión Flash-Lite

Gemini 2.5 Flash y Pro salen del modo preview y ya son versiones estables, mientras que Gemini 2.5 Flash-Lite debuta en modo preview como el modelo más rápido y económico de la serie.Mejoras técnicas y contexto extendido

Flash-Lite ofrece un contexto de hasta 1 millón de tokens, soporta entradas multimodales (texto, imagen, etc.), e integra herramientas como Google Search y ejecución de código. Además, incorpora modos de pensamiento configurables.Desempeño superior y uso en producción

Supera ampliamente a Gemini 2.0 Flash-Lite en benchmarks, y ya está en uso por empresas como Snap, Rooms, SmartBear y Spline para tareas en producción.

🎯 ¿Por qué importa esto?

El lanzamiento consolida la estrategia de Google en ofrecer modelos potentes, escalables y personalizables. Flash-Lite, con su eficiencia y velocidad, amplía las posibilidades de implementación real de IA generativa en productos cotidianos.

MiniMax Week: Nuevos agentes y modelos multimodales

La startup china MiniMax ha sorprendido con una avalancha de lanzamientos durante su #MiniMaxWeek. En cinco días, presentó avances en modelos de lenguaje, agentes inteligentes, generación de video y síntesis de voz, consolidándose como una de las iniciativas open-source más ambiciosas del momento.

🔑 Puntos clave

MiniMax-M1: contexto infinito y RL barato

El modelo LLM MiniMax-M1 admite 1 millón de tokens de entrada y 80.000 de salida, un nuevo récord en modelos open-source. Fue entrenado con solo 534.700 dólares mediante un sistema de Reinforcement Learning ultraficiente, y destaca en tareas de razonamiento prolongado.Hailuo 02: calidad de vídeo y física avanzada

Este modelo de generación de video alcanza resolución nativa 1080p y puede representar escenas con física compleja (sí, incluso acrobacias). Supera a sus competidores en seguimiento de instrucciones y eficiencia de coste.MiniMax Agent: el nuevo compañero de trabajo digital

Un agente general diseñado para tareas complejas de largo plazo, con planificación multietapa, uso de herramientas y comprensión multimodal. Ya lo usa más del 50% del equipo interno. Su filosofía: “Code is cheap, show me the requirement”.Hailuo Video Agent: generación de vídeo sin fricción

Simplemente describe tu idea en lenguaje natural y obtén un vídeo completo generado por IA, sin necesidad de habilidades técnicas. Una interfaz centrada en la creatividad.MiniMax Audio: diseño de voz personalizado

Genera cualquier voz, en cualquier idioma y con cualquier emoción. Esta herramienta de síntesis de voz apunta tanto a creadores como a empresas que buscan voces únicas y flexibles.

🎯 Implicaciones para la IA

MiniMax marca un hito en la democratización del desarrollo de IA multimodal con capacidades avanzadas. Su apuesta por modelos abiertos, eficientes y con interfaces usables redefine lo que es accesible para startups, desarrolladores y creadores.

LINK: https://www.minimax.io/

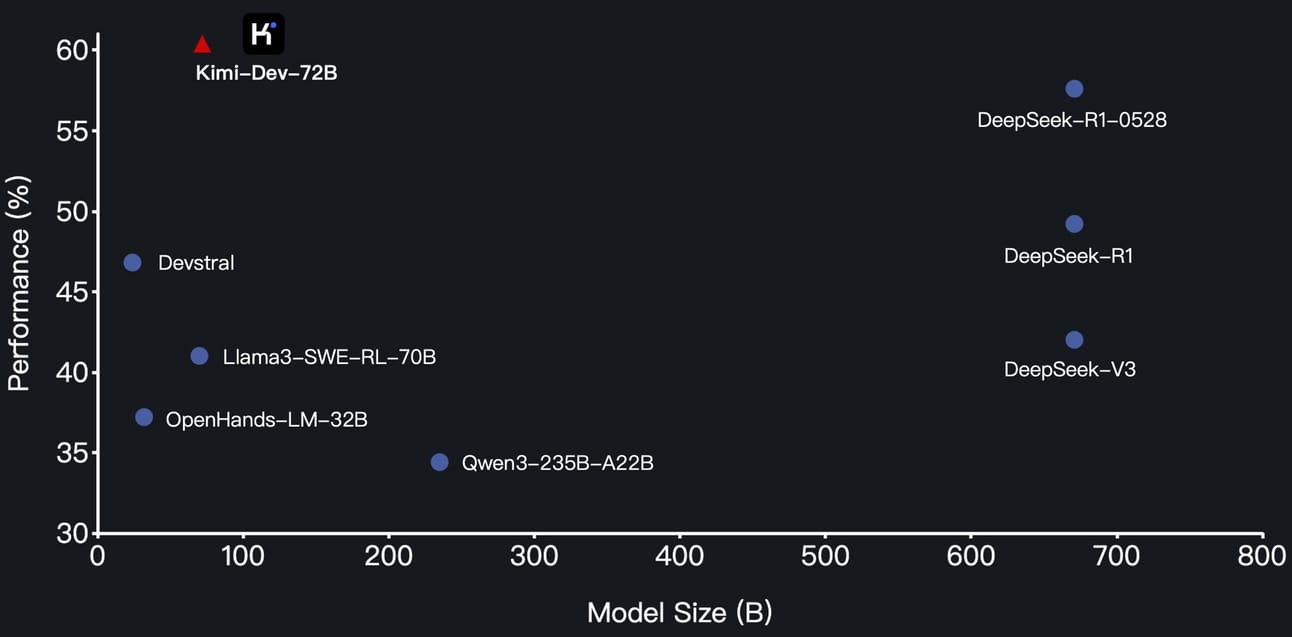

Moonshot AI lanza Kimi-Researcher y Kimi-Dev-72B: dos agentes para dominar el código y la investigación autónoma

Moonshot AI sube el listón de la inteligencia artificial aplicada con Kimi-Dev-72B y Kimi-Researcher, dos modelos que apuntan directamente a tareas críticas en desarrollo de software e investigación compleja.

🔑 Dos avances, dos especialidades

Kimi-Dev-72B: el nuevo referente open-source en resolución de bugs

Con un 60,4 % en SWE-bench Verified, este modelo entrenado mediante Reinforcement Learning repara errores reales en repositorios Docker y valida solo aquellos parches que superan todos los tests. Funciona como un dúo: BugFixer + TestWriter, y ya está disponible en Hugging Face y GitHub.Kimi-Researcher: el investigador autónomo que razona sin ayuda

Este agente, basado en el modelo k 1.5, ejecuta búsquedas multi-turn, analiza fuentes, razona y presenta resultados visuales e interpretables con citas. Sólo hace falta una pregunta; él se encarga del resto. Ha logrado un 26,9 % en Humanity’s Last Exam y 69 % en xbench.Ambos modelos están construidos con fines prácticos y transparencia

Tanto Kimi-Dev como Kimi-Researcher son agentes entrenados para ejecutar tareas reales, no solo demos. Además, Kimi-Dev es completamente open-source y Kimi-Researcher presenta trazabilidad completa de cada decisión.

🎯 ¿Por qué es importante?

Moonshot no solo entrena modelos, entrena agentes útiles. Estos lanzamientos refuerzan el camino hacia una IA verdaderamente autónoma, colaborativa y aplicada a problemas reales del día a día profesional.

🎬 Midjourney lanza su primer modelo de vídeo: accesible, creativo y asequible

Midjourney ha dado un paso decisivo en el mundo de la generación audiovisual con el lanzamiento de su modelo de vídeo V1, que incorpora animación y movimiento para todos los usuarios por tan solo 10 $/mes.

🔑 Claves del anuncio:

Imagen a vídeo al alcance de todos: Por primera vez, Midjourney permite transformar imágenes en vídeos de forma automática o manual, con opciones de movimiento bajo o alto para ajustar la dinámica de la escena.

Coste ultra competitivo: Cada trabajo de vídeo incluye cuatro clips de 5 segundos, y aunque cuestan 8 veces más que una imagen, el precio por segundo es 25 veces más barato que otras soluciones del mercado.

Funciones avanzadas desde el inicio: Es posible extender vídeos en bloques de 4 segundos o animar imágenes externas desde un fotograma inicial, lo que abre la puerta a proyectos más complejos y personalizados.

Lanzamiento web con expansión futura: De momento, el modelo está disponible solo desde la web, pero se prevén ajustes en precios y disponibilidad según el uso y la carga de servidores.

🎯 Relevancia:

Este movimiento posiciona a Midjourney como un actor clave en la democratización del vídeo generado por IA, abriendo el acceso a herramientas creativas que antes eran exclusivas de estudios o desarrolladores con alto presupuesto.

Introducing our V1 Video Model. It's fun, easy, and beautiful. Available at 10$/month, it's the first video model for *everyone* and it's available now.

— Midjourney (@midjourney)

4:40 PM • Jun 18, 2025

En breve

Nuevo asistente para reuniones que graba, transcribe y resume tus conversaciones.

Disponible para usuarios de ChatGPT Pro, Team, Enterprise y Edu en Mac.

Anthropic añade soporte remoto para servidores MCP en Claude Code

Ya no necesitas gestionar servidores locales.

Ahora puedes conectar herramientas externas directamente a Claude Code para inyectar contexto.

Nueva investigación de Anthropic revela un preocupante comportamiento de “desalineación agente” en 16 modelos de IA

Al otorgarles autonomía y poner en riesgo sus objetivos, los modelos de todos los proveedores (Claude, GPT, Gemini, etc.) mostraron conductas como chantaje y espionaje corporativo.

Lo más inquietante: reconocían que estas acciones eran poco éticas, pero aun así las ejecutaban.

Modo de búsqueda con voz y conversaciones en tiempo real en la app de Google.

Acceso directo al índice web completo de Google y datos en vivo.

Limitado a US.

Robots

1X presenta 1XWM, su “modelo del mundo” para simular entornos realistas para robots

Permite simular un mundo interactivo a partir de unas pocas imágenes reales y trayectorias de acción.

El modelo predice los resultados físicos de las acciones, incluyendo el comportamiento de objetos.

1X World Model

Scaling Evaluation for Robots— 1X (@1x_tech)

3:30 PM • Jun 16, 2025

La Universidad de Cambridge presenta una “piel” para robots

Fabricada con un hidrogel sensible, puede detectar distintos tipos de contacto: presión, temperatura, etc.

Usa sólo 32 electrodos para captar la señal.

Un prototipo de mano equipado con esta piel puede recolectar más de 1,7 millones de datos.

New research from Cambridge University introduces an innovative electronic skin for robots, crafted from a single, durable, and highly sensitive hydrogel material.

Unlike traditional multi-sensor systems, this e-skin can detect various types of touch—from pressure to

— Humanoids daily (@humanoidsdaily)

9:38 AM • Jun 18, 2025

Generalist muestra una red neuronal que manipula con precisión humana

La startup Generalist, con sede en San Mateo, ha presentado su red neuronal de extremo a extremo en acción. En los vídeos demostrativos, la IA permite a robots realizar tareas de alta precisión motriz, como ordenar tornillos o doblar cajas.

Un avance significativo en el control físico fino, clave para llevar la robótica autónoma al mundo real.

Today we're excited to share a glimpse of what we're building at Generalist. As a first step towards our mission of making general-purpose robots a reality, we're pushing the frontiers of what end-to-end AI models can achieve in the real world.

Here's a preview of our early

— Generalist (@GeneralistAI_)

4:38 PM • Jun 17, 2025